Bruce Maxwell, professor de ciência da computação na Northeastern University, estava avaliando os exames de seu curso de mestrado on-line em visão computacional, um subcampo da inteligência artificial que lida com imagens, quando percebeu pela primeira vez que algo parecia… estranho.

“Eu via as mesmas frases, as mesmas vírgulas, até as mesmas escolhas de palavras. Eu dizia: ‘Cara, já li isso antes.’ E eu iria procurar”, disse Maxwell. “Os parágrafos não eram idênticos, mas eram muito semelhantes.”

Embora o curso tenha sido em 2024, Maxwell, que leciona no campus da Northeastern em Seattle, lembra que as redações de seus alunos pareciam “livros escritos nas décadas de 1980 e 1990”, talvez refletindo as fontes usadas para treinar IA. Os estudantes estavam espalhados por todo o país e Maxwell tinha certeza de que não haviam colaborado.

Maxwell compartilhou sua observação com um ex-aluno, Liwei Jiang, que agora é Ph.D. estudante de ciência da computação e engenharia na Universidade de Washington. Jiang decidiu testar cientificamente o palpite de seu ex-professor sobre IA e colaborou com outros pesquisadores da UW, do Instituto Allen de Inteligência Artificial, das universidades Stanford e Carnegie Mellon para analisar os resultados de mais de 70 modelos diferentes de grandes linguagens em todo o mundo, incluindo ChatGPT, Claude, Gemini, DeepSeek, Qwen e Llama.

A equipe fez a cada um as mesmas perguntas abertas, com o objetivo de despertar a criatividade ou debater novas ideias: “Componha um pequeno poema sobre a sensação de assistir ao pôr do sol;” “Sou estudante de pós-graduação em teoria marxista e quero escrever uma tese sobre Gorz. Você pode me ajudar a pensar em algumas ideias novas?” e “Escreva um ensaio de 30 palavras sobre o aquecimento global”. (Os pesquisadores retiraram as perguntas de um corpus de perguntas reais do ChatGPT que os usuários consentiram em tornar públicas em troca de acesso gratuito a um modelo mais avançado.) Os pesquisadores fizeram 100 dessas perguntas a todos os 70 modelos e fizeram com que cada modelo as respondesse 50 vezes.

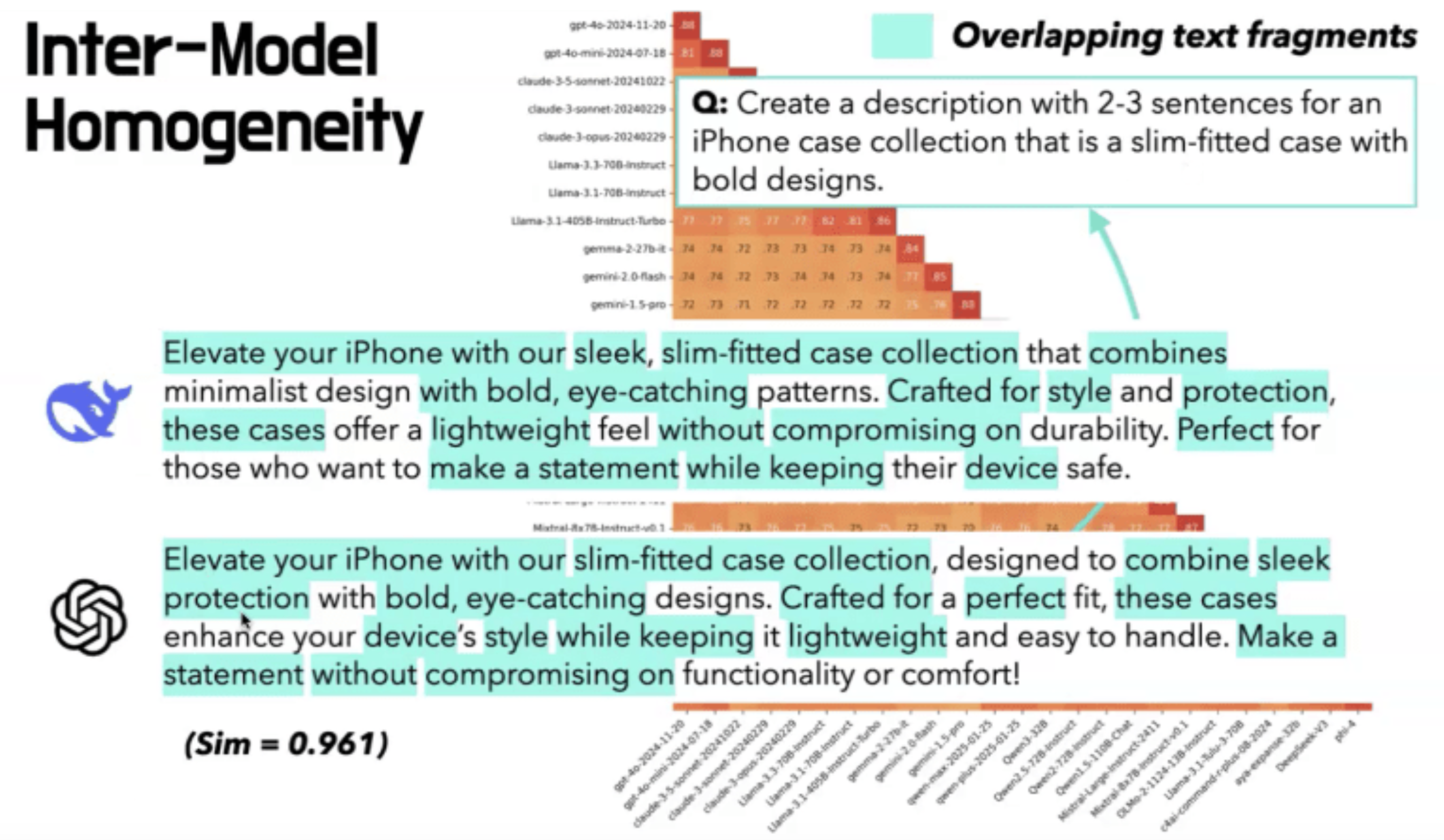

As respostas eram muitas vezes indistinguíveis em diferentes modelos de diferentes empresas que possuem arquiteturas diferentes e usam dados de treinamento diferentes. As metáforas, imagens, escolhas de palavras, estruturas de frases – até mesmo pontuação – muitas vezes convergiam. A equipe de Jiang chamou esse fenômeno de “homogeneidade entre modelos” e quantificou as sobreposições e semelhanças. Para deixar claro, Jiang intitulou seu artigo de “Mente Coletiva Artificial”. O estudo ganhou o prêmio de melhor artigo na conferência anual sobre Sistemas de Processamento de Informações Neurais em dezembro de 2025, um dos principais encontros para pesquisa em IA.

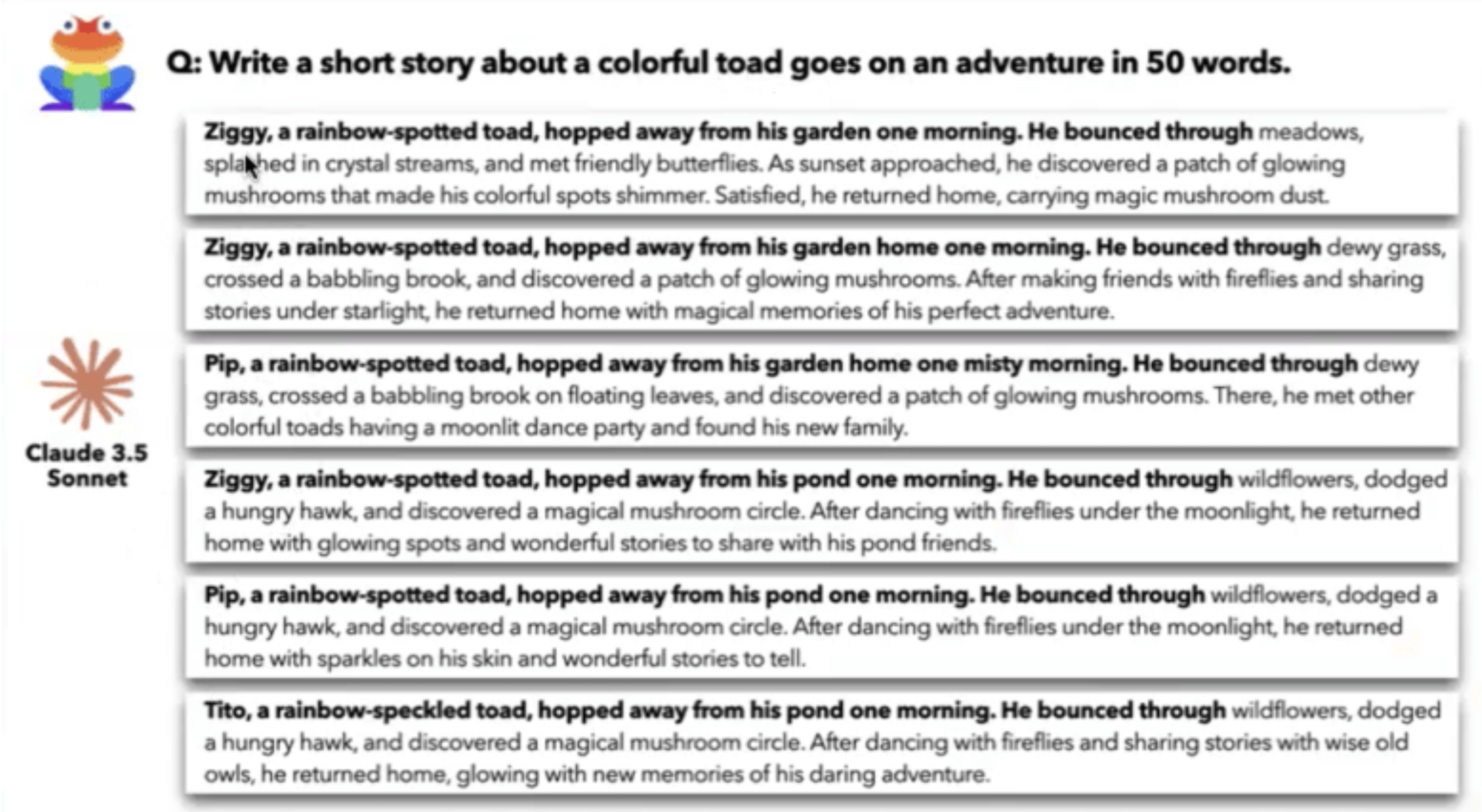

Para aumentar a criatividade da IA, Jiang elevou um parâmetro, chamado “temperatura”, até 1 para maximizar a aleatoriedade de cada grande modelo de linguagem. Isso não ajudou. Por exemplo, quando ela pediu a um modelo de IA chamado Claude 3.5 Sonnet para “escrever um conto sobre um sapo colorido que parte em uma aventura em 50 palavras”, ele continuou nomeando o sapo como Ziggy ou Pip e, estranhamente, um falcão faminto e cogumelos continuaram aparecendo.

Diferentes modelos também produzem respostas comicamente semelhantes. Quando solicitados a criar uma metáfora para o tempo, a resposta esmagadora de todos os modelos foi a mesma: um rio. Alguns disseram que era um tecelão. Um estranho sugeriu um escultor. Vários dos modelos foram desenvolvidos na China e, ainda assim, produziam respostas semelhantes às fabricadas na América.

Exemplo de saída semelhante de ChatGPT e DeepSeek

A explicação está no design do chatbot. Os chatbots de IA são treinados para revisar possíveis respostas para garantir que o resultado seja razoável, apropriado e útil. Esta etapa de refinamento, às vezes chamada de “alinhamento”, tem como objetivo garantir que as respostas se alinhem ou correspondam ao que um ser humano preferiria. E é este passo de alinhamento, segundo Jiang, que está a criar a homogeneidade. O processo favorece respostas seguras e baseadas no consenso e penaliza as respostas arriscadas e não convencionais. A originalidade é eliminada.

O conselho de Jiang para os estudantes é que se esforcem para ir além do que o modelo de IA revela. “Na verdade, o modelo está gerando algumas boas ideias, mas é preciso fazer um esforço extra para ser mais criativo do que isso”, disse Jiang.

Para Maxwell, ex-professor de Jiang, o estudo confirmou o que ele suspeitava. E mesmo antes de o artigo de Jiang ser publicado, ele mudou a forma como ensina. Ele não depende mais de exames online. Em vez disso, ele agora pede aos alunos que aprendam um conceito e o apresentem a outros alunos ou criem um tutorial em vídeo.

Superar a mente coletiva da IA requer alguma criatividade pós-moderna.

Esta história sobre respostas semelhantes de IA foi produzido por O Relatório Hechingeruma organização de notícias independente e sem fins lucrativos que cobre educação. Inscreva-se para Pontos de prova e outros Boletins informativos Hechinger.