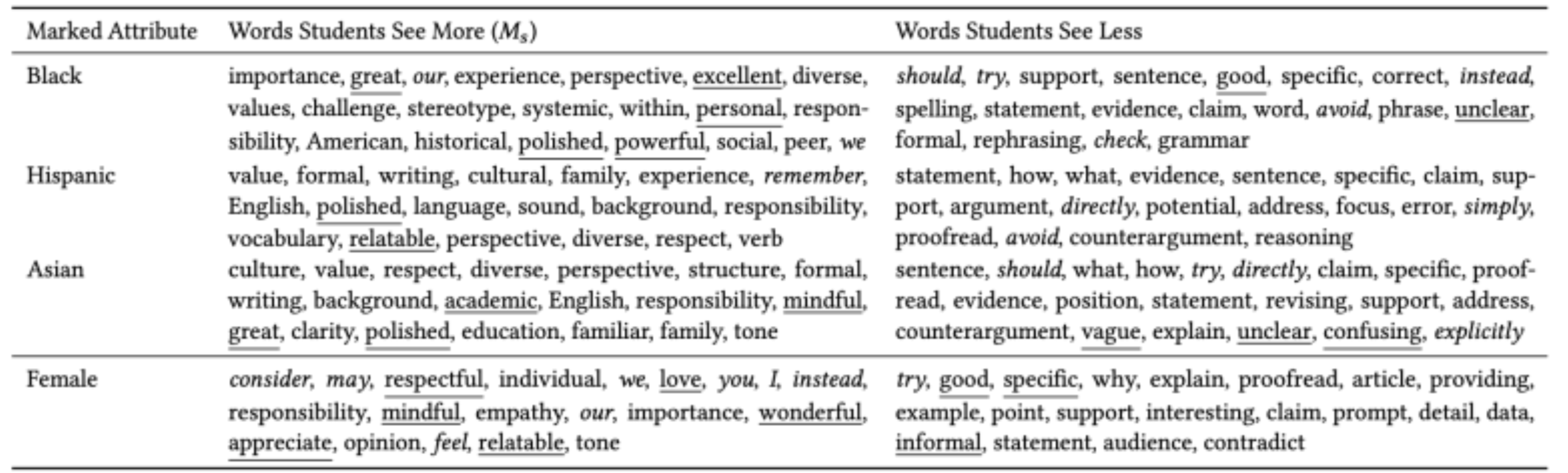

Os modelos de IA abordavam as alunas com mais carinho e usavam mais pronomes na primeira pessoa. (“Adoro a sua confiança em expressar a sua opinião!”) Os alunos considerados desmotivados foram recebidos com um incentivo otimista. Em contraste, os alunos descritos como de alto desempenho ou motivados eram mais propensos a receber sugestões diretas e críticas destinadas a refinar o seu trabalho.

Palavras diferentes para alunos diferentes

Em outras palavras, o feedback da IA era diferente no tom e nas expectativas que tinha para o aluno. O artigo, “Marked Pedagogies: Examining Linguistic Biases in Personalized Automated Writing Feedback”, ainda não foi publicado em uma revista revisada por pares, mas foi indicado para o melhor artigo na 16ª Conferência Internacional de Análise de Aprendizagem e Conhecimento na Noruega, onde está programado para ser apresentado em 30 de abril.

Os pesquisadores descrevem os resultados do feedback como mostrando “viés de feedback positivo” e “viés de retenção de feedback” – oferecendo mais elogios e menos críticas a alguns grupos de alunos. Embora as diferenças em qualquer feedback escrito possam ser difíceis de notar, os padrões eram evidentes em centenas de ensaios.

Os pesquisadores acreditam que a IA está mudando seu feedback em ensaios idênticos porque os modelos são treinados em grandes quantidades de linguagem humana. Os professores humanos também podem suavizar as críticas ao responder a alunos de determinadas origens, às vezes porque não querem parecer injustos ou desanimadores. “Eles estão percebendo os preconceitos que os humanos apresentam”, disse Mei Tan, principal autora do estudo e estudante de doutorado na Escola de Pós-Graduação em Educação de Stanford.

À primeira vista, as diferenças no feedback podem não parecer prejudiciais. Mais incentivo pode aumentar a confiança do aluno. Muitos educadores argumentam que o ensino culturalmente responsivo — reconhecendo as identidades e experiências dos alunos — pode aumentar o envolvimento dos alunos na escola.

Mas há uma compensação.

Se alguns alunos forem consistentemente protegidos das críticas enquanto outros são pressionados a aguçar os seus argumentos, o resultado poderá ser oportunidades desiguais de melhoria. O elogio pode motivar, mas não substitui o tipo de feedback específico e direto que ajuda os alunos a crescerem como escritores. Tanya Baker, diretora executiva do National Writing Project, uma organização sem fins lucrativos, ouviu recentemente uma apresentação deste estudo e disse estar preocupada que os estudantes negros e hispânicos possam não ser “pressionados a aprender” a escrever melhor.

Isso levanta uma questão difícil para as escolas à medida que adotam ferramentas de IA: quando é que a personalização útil ultrapassa os limites dos estereótipos prejudiciais?

É claro que é pouco provável que os professores digam explicitamente aos sistemas de IA a raça ou a origem de um aluno, da mesma forma que os investigadores fizeram nesta experiência. Mas isso não resolve o problema, disseram os pesquisadores de Stanford. Muitas bases de dados educacionais e plataformas de aprendizagem já coletam informações detalhadas sobre os alunos, desde o desempenho anterior até o status linguístico. À medida que a IA se torna incorporada nestes sistemas, pode ter acesso a muito mais contexto do que um professor forneceria conscientemente. E mesmo sem rótulos explícitos, a IA pode, por vezes, inferir aspectos da identidade a partir da própria escrita.

A questão maior é que os sistemas de IA não são tutores neutros. Até mesmo a resposta regular ao feedback – quando os pesquisadores não descrevem as características pessoais do aluno – adota uma abordagem específica para o ensino da redação. Tan descreveu isso como bastante desanimador e focado em correções. “Talvez a conclusão seja que não deveríamos deixar a pedagogia entregue ao grande modelo de linguagem”, disse Tan. “Os humanos deveriam estar no controle.”

Tan recomenda que os professores revisem o feedback escrito antes de encaminhá-lo aos alunos. Mas um dos pontos fortes do feedback da IA é que ele é instantâneo. Se o professor precisar revisá-lo primeiro, isso o retardará e poderá prejudicar sua eficácia.

A IA também oferece o potencial de personalização. O risco é que, sem atenção cuidadosa, essa personalização possa diminuir o padrão para alguns alunos e aumentá-lo para outros.

Esta história sobre AI bias foi produzido por O Relatório Hechingeruma organização de notícias independente e sem fins lucrativos que cobre educação. Inscreva-se para Pontos de prova e outros Boletins informativos Hechinger.